Fine-tuning explicado: Cómo hacer que un modelo de lenguaje aprenda tu idioma (y no el de todo Internet)

Si alguna vez intentaste explicarle con palabras a alguien cómo hacer algo y simplemente no entendió hasta que lo practicó, ya entiendes qué es el fine-tuning. Así funciona también con los LLMs.

Tu modelo sabe mucho, pero no sabe tu idioma

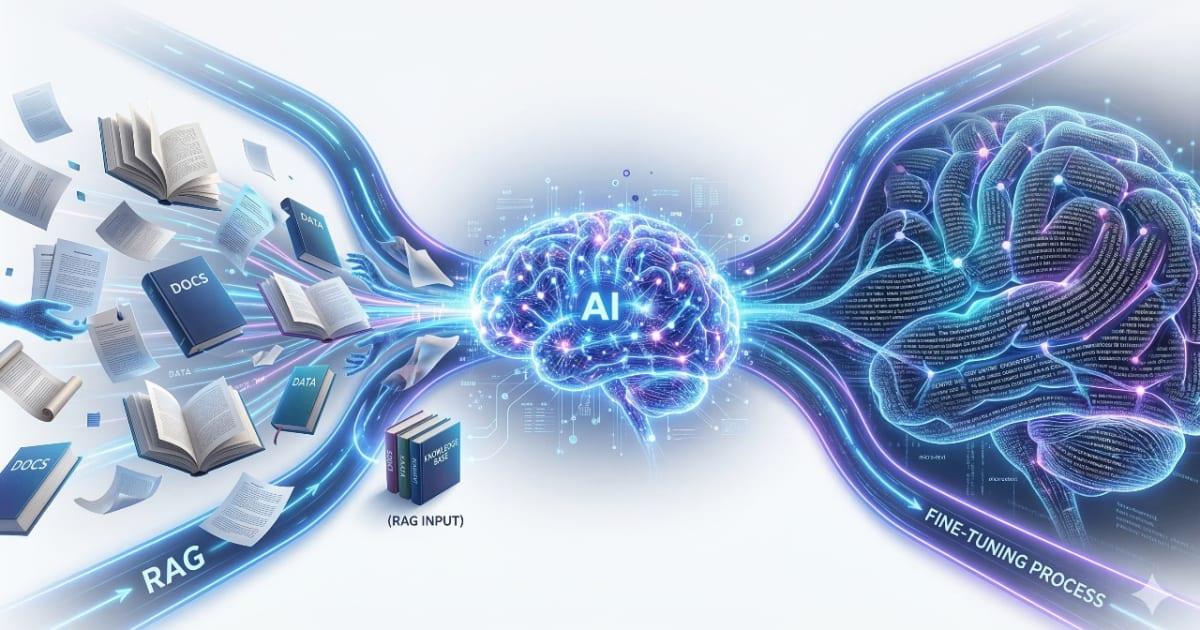

Los modelos de lenguaje grandes (LLM) son impresionantes. Han leído más texto que cualquier ser humano en toda la historia. Y aun así, hay cosas que simplemente no saben hacer bien: escribir como tu empresa, entender las abreviaturas de tu industria o generar el formato exacto que necesita tu equipo. Para eso existen dos técnicas que se complementan sin ser lo mismo: RAG y fine-tuning.

Ya hemos hablado de RAG en otro post. Hoy le toca al fine-tuning. Y no, no es lo mismo. Confundirlos es como pensar que darle a alguien un GPS es igual a enseñarle a manejar.

Primero, el origen: el pre-training

Antes de hablar de fine-tuning, hay que entender cómo nació el modelo. Todo LLM pasa por un proceso llamado pre-training, que es básicamente leer todo Internet —o algo muy parecido— y aprender a predecir cuál es la siguiente palabra en una oración.

Parecido a cuando llevas años leyendo novelas de terror y empiezas a predecir que el personaje que "solo será un momento" en el sótano, definitivamente no va a volver. Tu cerebro aprendió patrones. El modelo hace exactamente lo mismo, pero con cientos de miles de millones de palabras y sin el trauma emocional.

El resultado es un modelo que genera texto que suena como el contenido que existe en Internet. Genial para muchas cosas. Terrible si necesitas algo muy específico.

¿Qué es el fine-tuning?

El fine-tuning es continuar ese entrenamiento, pero con un dataset mucho más pequeño y enfocado. Si el pre-training es la preparatoria donde aprendes de todo un poco, el fine-tuning es la especialización donde te enfocas en un solo tema. Es como un médico general que decide convertirse en cirujano cardiovascular: ya tiene la base, solo necesita práctica dirigida.

Lo interesante es que no necesitas millones de ejemplos. Un modelo pre-entrenado con cientos de miles de millones de palabras puede cambiar su comportamiento significativamente con tan solo 10,000, 100,000 o un millón de palabras adicionales. Poco entrenamiento, gran impacto. Algo que ojalá aplicara también a los gimnasios.

¿Cuándo usar fine-tuning? Cuatro casos reales

1. Cuando el formato importa más que el contenido

Si has usado alguna vez una hoja de ruta de proyectos en una empresa grande, sabes que hay un formato sagrado que nadie viola. Los LLMs genéricos no conocen ese formato. Puedes intentar describirlo en el prompt, claro. Pero hay tareas donde explicar el formato exacto mediante instrucciones es complicado, impreciso y frustrante.

Es como intentar explicarle a alguien cómo hacer un nudo de corbata por teléfono. Técnicamente posible. Prácticamente un desastre.

En cambio, si construyes un dataset con cientos de ejemplos del formato correcto —por ejemplo, resúmenes de llamadas de atención al cliente con el estilo exacto que usa tu empresa— y entrenas el modelo con eso, el modelo aprende el patrón sin que tengas que explicarlo cada vez.

2. Cuando necesitas imitar un estilo de escritura o de habla

Describir un estilo en un prompt es como describir el sabor del cilantro a alguien que nunca lo ha probado. Puedes intentarlo, pero vas a quedar corto.

Si tienes transcripciones reales de cómo habla una persona o un personaje, puedes hacer fine-tuning con esos textos y el modelo aprenderá ese estilo con mucha más precisión. Esto es útil para asistentes virtuales personalizados, personajes de videojuegos, contenido creativo o cualquier caso donde la voz importa tanto como el mensaje.

3. Cuando tu industria habla otro idioma

No inglés técnico. Otro idioma de verdad.

Un registro médico puede incluir abreviaturas como Pt (patient), c/o (complaining of), SOB (shortness of breath) o DOE (dyspnea on exertion). Para un LLM entrenado con texto general de Internet, eso no es inglés médico, es ruido.

Lo mismo pasa con documentos legales llenos de frases como "Licensor grants to licensee per Section 2(a)(iii) a non-exclusive right…" o con términos como hereof que casi nadie usa en una conversación normal. Y ni hablar de los reportes financieros, que tienen su propio universo semántico paralelo.

El fine-tuning con documentos del sector permite que el modelo entienda, procese y genere texto en ese lenguaje especializado. Es la diferencia entre contratar a alguien que "sabe algo de medicina" y contratar a alguien que trabajó diez años en urgencias.

4. Cuando quieres resultados grandes con modelos pequeños

Los modelos enormes de 100 mil millones de parámetros son poderosos, pero también son lentos, caros y exigentes en hardware. No todos pueden —ni quieren— mantener una GPU de alto rendimiento encendida las 24 horas del día solo para clasificar correos.

Un modelo pequeño de un billón de parámetros puede correr en una laptop, en un teléfono, en una PC normal. Si ese modelo se fine-tunea con un dataset específico para una tarea concreta —clasificar reseñas de restaurantes, detectar spam, resumir tickets de soporte— puede hacerlo casi tan bien como un modelo gigante. Con cientos o miles de ejemplos bien seleccionados es suficiente.

Es decir, no siempre necesitas al campeón mundial para ganar la liga local. A veces basta con entrenar bien al equipo que ya tienes.

Fine-tuning vs RAG: ¿cuál usar?

No son competidores. Son herramientas distintas para problemas distintos.

RAG es ideal cuando la información cambia frecuentemente, cuando es demasiado grande para meterla en el modelo, o cuando necesitas que el modelo cite fuentes. RAG le pasa los documentos al modelo en el momento de la consulta, como un asistente que te entrega el expediente justo antes de la reunión.

Fine-tuning es ideal cuando necesitas cambiar el comportamiento base del modelo: su estilo, su vocabulario, su formato de respuesta. El conocimiento queda grabado en el modelo, no se pasa en cada consulta. Es el equivalente a entrenar al asistente durante semanas para que ya sepa todo de memoria.

Y si te preguntas si puedes combinar ambos: sí, puedes. Y a veces es la mejor opción posible. Aunque implementarlo correctamente ya requiere su propio post —y su propio presupuesto.

¿Cuánto cuesta todo esto?

Aquí viene la parte que a los directores financieros les encanta escuchar:

- RAG: Bajo costo. Modificas prompts y conectas un sistema de búsqueda.

- Fine-tuning: Costo bajo a moderado. Puede ir de decenas a cientos de dólares dependiendo del tamaño del dataset y el modelo.

- Pre-training desde cero: Millones de dólares. Solo empresas como Google, Meta o Anthropic lo hacen. Si estás considerando esta opción, probablemente no estás leyendo un blog, estás firmando contratos de inversión.

Resumen ultracompacto

- Pre-training: el modelo aprende de todo Internet para predecir texto.

- Fine-tuning: entrenamiento adicional enfocado que cambia estilo, vocabulario o formato.

- Casos de uso: formatos complejos, estilos de escritura, lenguaje especializado, modelos pequeños eficientes.

- RAG vs Fine-tuning: RAG da información en el momento; fine-tuning la graba en el modelo.

- Costos: RAG (bajo) → Fine-tuning (moderado) → Pre-training (millones, no para mortales).

- Combinación posible: RAG + Fine-tuning juntos = máxima precisión, máxima complejidad.

Tags relacionados:

Jesus Eusse

Ingeniero apasionado por la tecnología y desarrollo personal

Comparte este artículo